Najważniejsze fakty (Executive Summary)

[!IMPORTANT]

- Data graniczna: 2 sierpnia 2026 r. to data rozpoczęcia stosowania zdecydowanej większości przepisów AI Act - wszystkie kancelarie w Polsce używające AI muszą je od tej pory bezwzględnie stosować i przestrzegać.

- Obowiązek edukacyjny: Od 2 lutego 2026 r. obowiązuje już wymóg AI Literacy, nakazujący wewnętrzne procedury i szkolenia z AI.

- Klasyfikacja ryzyka: Większość narzędzi prawniczych, jak LexAlpha używanych do researchu, to systemy ograniczonego ryzyka, z wyłączeniem profilowania HR czy wsparcia wyroków.

- Kary i RODO: Sankcje sięgają 35 mln EUR (albo 7% obrotu) za stosowanie zakazanych praktyk AI - możliwe łączenie z karami z RODO. Brak polskiego organu nadzoru nie chroni przed odpowiedzialnością.

Wprowadzenie: Co to jest AI Act i dlaczego dotyczy Twojej kancelarii?

2 sierpnia 2026 roku to data, której żadna kancelaria prawna w Polsce nie może zignorować. Od tego dnia większość przepisów unijnego rozporządzenia o sztucznej inteligencji - powszechnie zwanego AI Act - znajdzie swoje pełne zastosowanie i zacznie bezwzględnie obowiązywać (tzw. rozpoczęcie stosowania). Dotyczy to nie tylko firm technologicznych tworzących systemy AI, ale każdego podmiotu, który z takich systemów korzysta zawodowo - w tym kancelarii adwokackich, radcowskich i notarialnych.

Tymczasem w Polsce wciąż nie uchwalono krajowej ustawy implementującej AI Act, a prace legislacyjne są opóźnione o ponad 100 dni względem pierwotnych planów. Co to oznacza w praktyce? Że kancelarie muszą dostosować się do brzmienia unijnego rozporządzenia bezpośrednio - bez krajowego przewodnika. Kary za naruszenia mogą być nakładane nawet bez powołanego organu nadzoru, gdyż prawnicy podlegają innym, działającym już systemom odpowiedzialności (odpowiedzialność dyscyplinarna, odpowiedzialność odszkodowawcza).

Ten artykuł to praktyczny przewodnik dla partnerów i wspólników kancelarii prawnych. Dowiesz się z niego:

- jak działa AI Act i kogo naprawdę dotyczy,

- czy narzędzia AI używane w kancelarii to systemy wysokiego ryzyka zgodnie z AI Act,

- jakie konkretne obowiązki musisz spełnić przed 2 sierpnia 2026,

- jak sprawdzić, czy Twój dostawca AI jest zgodny z regulacją AI Act,

- i co zrobić, jeśli jeszcze nie zacząłeś przygotowań.

Czym jest AI Act i kogo dokładnie dotyczy w branży prawniczej?

AI Act to rozporządzenie Parlamentu Europejskiego i Rady (UE) 2024/1689 z 13 czerwca 2024 roku - pierwsze na świecie kompleksowe prawo regulujące systemy sztucznej inteligencji. Jako rozporządzenie unijne, obowiązuje bezpośrednio w całej UE, bez konieczności uchwalania krajowych ustaw wdrażających.

Regulacja opiera się na podejściu opartym o ryzyko: im wyższe potencjalne ryzyko wyrządzenia szkody przez system AI, tym surowsze wymogi prawne. AI Act wyróżnia cztery kategorie systemów:

| Kategoria | Przykłady | Wymogi |

|---|---|---|

| Niedopuszczalne ryzyko | Systemy oceny społecznej, manipulacja podprogowa | Zakaz stosowania |

| Wysokie ryzyko | Systemy w wymiarze sprawiedliwości, HR, ochronie zdrowia | Rygorystyczne wymogi, dokumentacja, nadzór |

| Ograniczone ryzyko | Chatboty, deepfakes, systemy rekomendacji | Obowiązki informacyjne (transparentność) |

| Minimalne ryzyko | Filtry spamu, kalkulatory, gry wideo | Brak szczególnych wymogów |

Kluczowe pytanie dla kancelarii brzmi: w której kategorii znajdują się narzędzia AI, z których korzystasz? Odpowiedź nie jest oczywista i zależy od tego, do czego konkretnie używasz danego systemu.

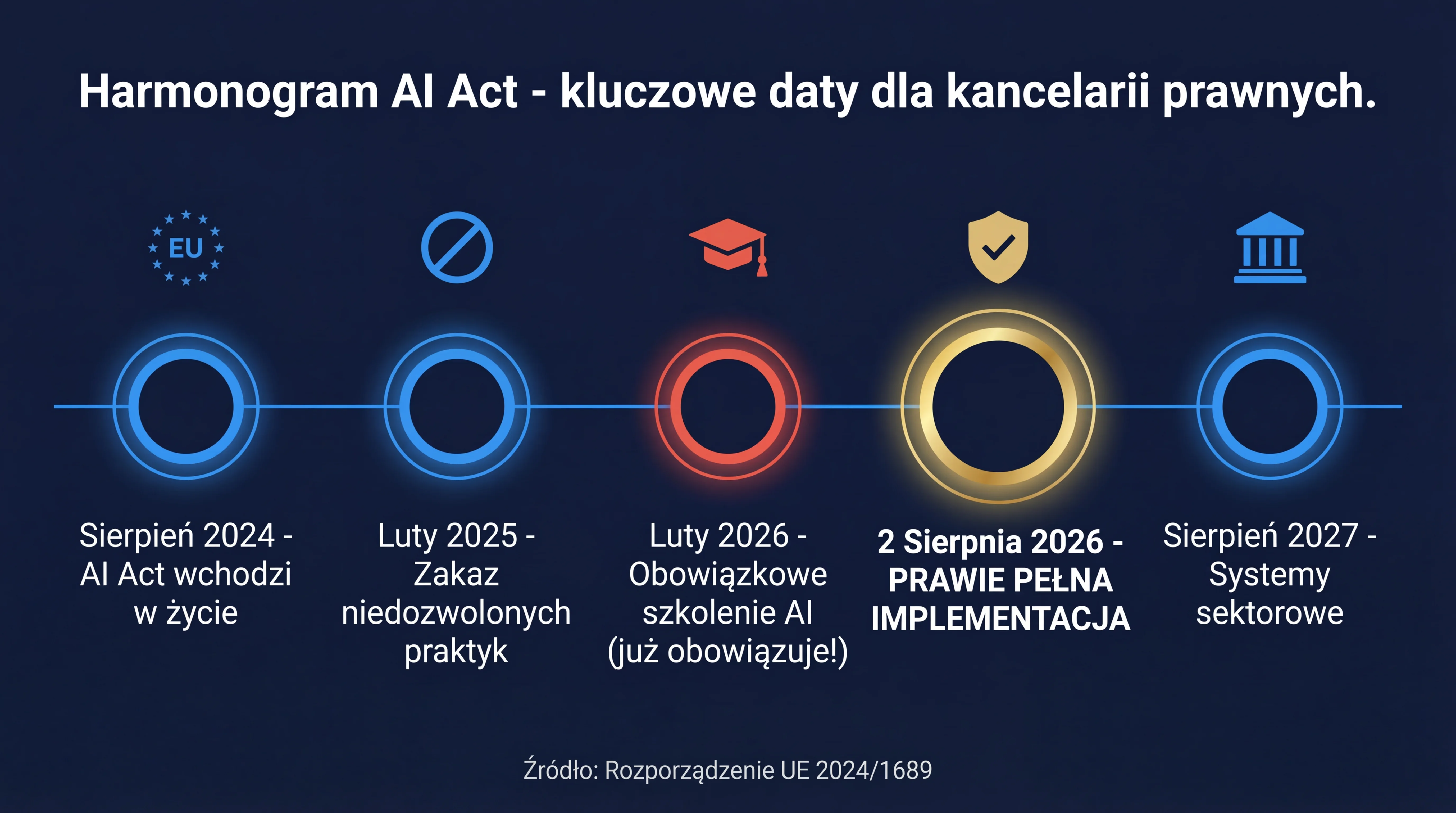

Harmonogram wejścia w życie AI Act: gdzie jesteśmy?

AI Act wprowadzany jest etapowo. Oto kompletna mapa dat, które już minęły lub nadchodzą:

| Data | Co weszło w życie |

|---|---|

| 1 sierpnia 2024 | AI Act wchodzi w życie jako rozporządzenie UE |

| 2 lutego 2025 | Przepisy ogólne, zakaz praktyk niedopuszczalnych |

| 2 lutego 2026 | Obowiązek AI literacy - szkolenia pracowników z zakresu AI |

| 2 sierpnia 2026 | Rozpoczęcie stosowania większości przepisów - systemy wysokiego ryzyka, obowiązki podmiotów stosujących |

| 2 sierpnia 2027 | Systemy wysokiego ryzyka zintegrowane z produktami sektorowymi |

Jak wyżej wspomnieliśmy, od 2 lutego br. obowiązuje już Art. 4 AI Act - czyli wymóg zapewnienia pracownikom kompetencji w zakresie AI (tzw. AI literacy). O tym, jak AI zmienia pracę prawników w 2026 pisaliśmy szczegółowo, ale w kontekście prawa ten obowiązek dotyczy Ciebie już od 2 lutego br. Jeśli przykładowo pracownik z powodu braku wiedzy doprowadzi do naruszenia np. zasad przejrzystości lub dopuści się zakazanych praktyk, brak wcześniejszych szkoleń w kancelarii będzie okolicznością obciążającą pracodawcę.

Do 2 sierpnia 2026 pozostało mniej niż 5 miesięcy. To wystarczający czas, by się przygotować - ale tylko jeśli zaczniesz działać teraz.

Czy kancelaria to „podmiot stosujący” AI Act?

Podmiot stosujący AI Act (ang. deployer) to każda osoba fizyczna lub prawna korzystająca z systemu AI w ramach swojej działalności zawodowej. Definicja z art. 3 pkt 4 Rozporządzenia 2024/1689 obejmuje kancelarie adwokackie, radcowskie i notarialne korzystające z narzędzi AI do researchu, pisania pism czy analizy dokumentów. Obowiązki podmiotów stosujących reguluje art. 26 AI Act.

AI Act nie nakłada obowiązków na prywatnych użytkowników korzystających z narzędzi takich jak ChatGPT do celów osobistych. Problem pojawia się dopiero, gdy to samo narzędzie jest używane zawodowo i zarobkowo.

Jakie kategorie ryzyka dotyczą kancelarii prawnych?

Generalnie:

Narzędzia analityczne i generatory pism prawniczych (np. LexAlpha)

Narzędzia wspomagające pracę prawnika - asystenci AI analizujący umowy, generatory pism procesowych w oparciu o przepisy, orzecznictwo i praktykę w danej kancelarii - zazwyczaj klasyfikują się jako systemy niskiego lub ograniczonego ryzyka, o ile nie wpływają bezpośrednio na prawa podstawowe osób fizycznych oraz na decyzyjność sądu (tzn. nie wspierają sądu w stosowaniu prawa do konkretnego stanu faktycznego oraz w jego interpretacji).

Oznacza to: mniej rygorystyczne wymogi formalne, głównie obowiązek transparentności (informowanie, że treść została wygenerowana przez AI) oraz zapewnienie nadzoru człowieka nad finalnym produktem.

W modelu review-first, stosowanym przez LexAlpha, prawnik pozostaje autorem i weryfikatorem pisma - AI jest asystentem, nie decydentem. To podejście jest domyślnie zgodne z wymogiem nadzoru człowieka (human oversight).

Systemy wspomagające wymiar sprawiedliwości

AI Act wprost wymienia w Załączniku III (AI Act Explorer - oficjalne narzędzie Komisji Europejskiej) systemy AI stosowane w wymiarze sprawiedliwości jako potencjalnie należące do kategorii wysokiego ryzyka - szczególnie te przeznaczone do analizy stanów faktycznych, oceny wiarygodności dowodów lub wspierania decyzji sądowych.

Kancelaria wdrażająca lub rozważająca wdrożenie AI do takich celów powinna przeprowadzić pełną ocenę klasyfikacji.

Systemy HR używane w kancelarii

Narzędzia AI do rekrutacji, oceny pracowników czy monitorowania wydajności pracowników są wprost wymienione w Załączniku III jako wysokiego ryzyka. Kancelaria korzystająca z takiego oprogramowania podlega pod pełen reżim stosowania przepisów AI Act od 2 sierpnia 2026.

Jakie obowiązki konkretnie ciążą na Twojej kancelarii?

Poniżej lista obowiązków dla podmiotów stosujących AI, które zaczną być stosowane od 2 sierpnia 2026 roku (samo rozporządzenie weszło w życie w sierpniu 2024 r.). Podzieliliśmy je na te dotyczące wszystkich kancelarii i te dotyczące kancelarii używających systemów wysokiego ryzyka.

Obowiązki dla każdej kancelarii używającej AI

1. AI literacy (już obowiązuje od 2 lutego 2026)

Musisz zapewnić, że osoby pracujące z systemami AI posiadają odpowiedni poziom wiedzy i kompetencji do ich bezpiecznego i świadomego używania. W praktyce oznacza to:

- przeprowadzenie szkoleń lub warsztatów z zakresu AI dla zespołu,

- opracowanie wewnętrznych procedur korzystania z narzędzi AI,

- dokumentację, że takie działania zostały podjęte.

2. Weryfikacja dostawcy AI

Jeśli korzystasz z zewnętrznego narzędzia AI, jesteś odpowiedzialny za sprawdzenie, czy Twój dostawca spełnia wymogi AI Act. Kluczowe pytania to:

- Czy dostawca dostarcza dokumentację techniczną systemu (np. udostępnia dokumentację techniczną LexAlpha)?

- Czy system jest odpowiednio opisany pod kątem możliwości i ograniczeń?

- Czy dane użytkowników nie są używane do trenowania modelu?

- Gdzie fizycznie są przechowywane dane (EU czy poza EOG)?

3. Informowanie o używaniu AI

W przypadku systemów generujących treści (jak pisma procesowe) prawnicy powinni mieć jasność co do tego, kiedy i w jaki sposób informować klientów o roli AI w przygotowaniu dokumentów. Szczegółowy zakres tego obowiązku zależy od klasyfikacji ryzyka systemu.

Dodatkowe obowiązki dla systemów wysokiego ryzyka

Jeśli używasz systemu AI zakwalifikowanego jako wysokiego ryzyka (np. AI w HR, AI wspomagające decyzje w wymiarze sprawiedliwości), musisz dodatkowo:

- Prowadzić rejestr zdarzeń - dokumentację zdarzeń i incydentów związanych z działaniem systemu,

- Przeprowadzić FRIA (Fundamental Rights Impact Assessment) - ocenę wpływu na prawa podstawowe, zbliżoną do DPIA z RODO,

- Zapewnić ludzki nadzór - wyznaczyć konkretną osobę odpowiedzialną za nadzór nad działaniem systemu AI,

- Monitorować działanie systemu na bieżąco i reagować na incydenty,

- Dostosować działanie do instrukcji dostawcy - nie można używać systemu w sposób odbiegający od jego przeznaczenia opisanego przez producenta.

Jakie kary grożą za naruszenia AI Act do 35 mln EUR?

Skala sankcji jest poważna i porównywalna z RODO:

Na mocy art. 99 ust. 3 Rozporządzenia 2024/1689, stosowanie zakazanych praktyk AI (art. 5) zagrożone jest karą do 35 mln EUR lub 7% światowego rocznego obrotu podmiotu. Naruszenia wymogów transparentności lub obowiązków podmiotów stosujących (art. 26) - do 15 mln EUR lub 3% obrotu (art. 99 ust. 4). Kary te mogą być kumulowane z sankcjami z art. 83 RODO, co w przypadku przetwarzania danych klientów kancelarii przez niezweryfikowany system AI może prowadzić do łącznej ekspozycji finansowej przekraczającej 50 mln EUR.

| Kategoria naruszenia | Kwota kary | Artykuł AI Act |

|---|---|---|

| Stosowanie zakazanych systemów AI | Do 35 mln EUR lub 7% rocznego obrotu | Art. 99 ust. 3 |

| Naruszenie obowiązków podmiotu stosującego (art. 26) | Do 15 mln EUR lub 3% obrotu | Art. 99 ust. 4 |

| Przekazywanie nieprawdziwych informacji organom nadzoru | Do 7,5 mln EUR lub 1% obrotu | Art. 99 ust. 5 |

Kary będą nakładane przez organ nadzoru - w Polsce planowana jest Komisja Rozwoju i Bezpieczeństwa Sztucznej Inteligencji (KRiBSI), choć jej powołanie ulega opóźnieniu. Jak już było wyżej wspomniane, brak polskiego organu nadzoru nie zwalnia jednak z obowiązków wynikających bezpośrednio z rozporządzenia UE.

Polska ustawa implementująca AI Act (Krajowe ramy prawne)

Projekt polskiej ustawy o sztucznej inteligencji opublikowany przez Ministerstwo Cyfryzacji w październiku 2024 roku wciąż jest na etapie konsultacji. Prace legislacyjne nad powołaniem polskiego organu nadzoru (Komisji Rozwoju i Bezpieczeństwa SI - KRiBSI) notują kilkumiesięczne opóźnienie.

Ta sytuacja ma konkretne konsekwencje dla kancelarii:

- Nie możesz czekać na polską ustawę - przepisy AI Act obowiązują bezpośrednio jako rozporządzenie UE, niezależnie od implementacji krajowej.

- Brak krajowego organu nadzoru i doprecyzowania procedur utrudnia planowanie compliance, ale nie eliminuje obowiązków.

- Niektóre kancelarie mylnie sądzą, że skoro polska ustawa nie weszła w życie, to AI Act jeszcze nie obowiązuje. To niebezpieczne nieporozumienie.

Checklist compliance AI Act dla kancelarii - co zrobić przed 2 sierpnia 2026?

Poniżej praktyczna lista działań, które powinna podjąć każda kancelaria korzystająca z narzędzi AI. Działania podzielono według pilności.

Do zrobienia natychmiast (jeśli jeszcze nie zostało zrobione)

- Inwentaryzacja narzędzi AI - stwórz listę wszystkich systemów AI używanych w kancelarii (ChatGPT, Copilot, narzędzia do analizy umów, systemy CRM z elementami AI, itp.)

- Wstępna klasyfikacja ryzyka - dla każdego narzędzia oceń wstępnie, do której kategorii ryzyka należy

- Szkolenie z AI literacy - zaplanuj i przeprowadź szkolenie dla prawników i pracowników kancelarii korzystających z AI (ten obowiązek już obowiązuje)

Do zrobienia w ciągu 60 dni

- Weryfikacja dostawców - dla każdego narzędzia AI zweryfikuj: gdzie są przechowywane dane, czy dane są używane do trenowania modelu, czy dostawca ma podpisany DPA zgodny z RODO

- Wewnętrzna polityka AI - opracuj dokument regulujący zasady korzystania z AI w kancelarii (kto może używać, do jakich celów, jak weryfikować wyniki)

- Procedura nadzoru - ustal, kto jest odpowiedzialny za nadzór nad systemami AI w kancelarii

Do zrobienia przed 2 sierpnia 2026

- Pełna ocena zgodności dla systemów wysokiego ryzyka (jeśli takie są używane)

- Ocena wpływu (FRIA) dla systemów wpływających na prawa podstawowe

- Rejestr zdarzeń dla systemów wysokiego ryzyka

- Aktualizacja umów z dostawcami AI - upewnij się, że umowy zawierają odpowiednie zapisy dotyczące AI Act

- Informowanie klientów - jeśli to konieczne, zaktualizuj regulaminy i polityki informacyjne kancelarii

Jak LexAlpha pomaga Twojej kancelarii być zgodną z AI Act?

Projektując LexAlpha, od początku uwzględniliśmy wymogi AI Act i RODO jako warunki konieczne, a nie opcje dodatkowe. Oto jak konkretnie platforma wspiera zgodność kancelarii z regulacją:

Dane nie trenują modelu AI

Dokumenty przesyłane do LexAlpha są przetwarzane wyłącznie w trakcie generowania odpowiedzi i nie są zapisywane ani wykorzystywane do trenowania modeli. To bezpośrednia odpowiedź na jeden z kluczowych wymogów AI Act dla podmiotów stosujących.

Hosting w EU z podpisanym DPA

Infrastruktura LexAlpha opiera się na Microsoft Azure w regionie EU, z podpisanym Data Processing Agreement zgodnym z RODO. Dane nie są przekazywane poza Europejski Obszar Gospodarczy.

Szyfrowanie standard bankowy

Wszystkie dane szyfrowane są kluczem AES-256 zarówno w spoczynku, jak i podczas transmisji - standard stosowany przez instytucje finansowe.

Model review-first = wbudowany human oversight

Architektura LexAlpha zakłada, że AI generuje propozycje (synteza faktów, strategia, podstawy prawne, orzecznictwo), ale ostateczna decyzja o każdym elemencie pisma należy do prawnika. To model w 100% spójny z wymogiem nadzoru człowieka (human oversight) wymaganym przez AI Act.

Granularna kontrola dostępu

System uprawnień pozwala precyzyjnie kontrolować, kto ma dostęp do jakich dokumentów i operacji - z logowaniem każdej czynności (z naciskiem na rejestr zdarzeń).

Przy wdrożeniu LexAlpha w kancelarii dostarczamy pełną dokumentację techniczną, zapewniając Twojej kancelarii pełne bezpieczeństwo prawnicze i cybernetyczne RODO/AI Act w zgodzie z prawem europejskim.

Najczęściej zadawane pytania (FAQ)

Czy kancelaria jednoosobowa też musi stosować się do AI Act?

Tak. AI Act obowiązuje niezależnie od wielkości kancelarii. Rozporządzenie 2024/1689 stosuje zasadę proporcjonalności (art. 25 ust. 2) - wymogi dla mikroprzedsiębiorców mogą być realizowane w uproszczony sposób, w szczególności gdy korzystają z gotowych rozwiązań niskiego ryzyka. Minimalny zakres: przeprowadzenie szkolenia z AI literacy (art. 4, obowiązuje od 2 lutego 2026), inwentaryzacja używanych narzędzi AI, oraz weryfikacja, czy dostawca narzędzia posiada DPA zgodny z RODO.

Jak przeprowadzić inwentaryzację narzędzi AI w kancelarii i które podlegają pod AI Act?

Inwentaryzacja rozpoczyna się od listy wszystkich narzędzi z komponentem AI: systemy do pisania pism (LexAlpha, ChatGPT), narzędzia CRM z AI, systemy do transkrypcji (Whisper, Otter.ai), narzędzia HR z elementami scoringowymi. Dla każdego określasz: kategorię ryzyka wg Załącznika III, lokalizację danych, status DPA. Narzędzia niskiego ryzyka (np. automatyczny draft) wymagają transparentności; narzędzia HR z profilowaniem - pełnego compliance wysokiego ryzyka.

Jakie szkolenie z AI literacy spełnia wymogi art. 4 AI Act dla kancelarii prawnej?

Art. 4 AI Act nie definiuje jednego wzorca szkolenia. W praktyce szkolenie powinno obejmować: zrozumienie możliwości i ograniczeń AI (halucynacje, bias), zasady bezpiecznego przetwarzania danych (RODO w kontekście AI), procedury weryfikacji generowanych tekstów prawnych, oraz obowiązki podmiotu z AI Act. Kluczowa jest dokumentacja potwierdzająca przeprowadzenie szkolenia w kancelarii: protokół szkolenia, lista obecności. Wiele izb ORA/OIRP uruchamia takie programy certyfikacyjne.

Co oznacza „AI literacy" wymagana przez AI Act?

Art. 4 AI Act nakłada obowiązek zapewnienia pracownikom korzystającym z AI odpowiednich kompetencji w zakresie tej technologii. W praktyce chodzi o: rozumienie możliwości i ograniczeń używanych narzędzi, znajomość procedur weryfikacji wyników AI, świadomość ryzyk (halucynacje, błędy, prywatność danych). Nie ma jednego wzorca szkolenia - ważna jest dokumentacja, że działania edukacyjne zostały podjęte.

Czy kancelaria musi informować klientów, że pisma były tworzone z pomocą AI?

Tak, należy poinformować klienta kancelarii, że pisma były tworzone z pomocą AI, gdy AI tworzy merytoryczną treść pisma czy umowy, bez względu na wymóg pełnej weryfikacji merytorycznej przez prawnika (nadzór człowieka). Takie wymogi ponadto często regulowane są w Regulaminie etycznym danej korporacji zawodowej (adwokackiej, radcowskiej). AI Act nie nakłada tu jednoznacznego obowiązku dla wszystkich przypadków, ale zasady etyki zawodowej i odpowiedzialność za jakość dokumentu pozostają po stronie prawnika niezależnie od tego, jakie narzędzia wykorzystał.

Jakie kary grożą za nieprzestrzeganie AI Act?

Najpoważniejsze naruszenia (stosowanie zakazanych systemów) zagrożone są karą do 35 mln EUR lub 7% światowego rocznego obrotu. Naruszenia wymogów dla systemów wysokiego ryzyka - do 15 mln EUR lub 3% obrotu. Kary mogą być kumulowane z sankcjami z RODO.

Czy AI Act dotyczy małych kancelarii (1-5 prawników)?

Tak, AI Act obowiązuje niezależnie od wielkości podmiotu. Rozporządzenie uwzględnia zasadę proporcjonalności - wymogi dla małych firm mogą być realizowane w uproszczony sposób, szczególnie gdy korzystają z gotowych rozwiązań niskiego ryzyka. Obowiązek AI literacy i weryfikacji dostawców dotyczy jednak wszystkich.

Jak sprawdzić, czy mój dostawca AI spełnia wymogi AI Act?

Zapytaj dostawcę o: dokumentację techniczną systemu, politykę przechowywania i przetwarzania danych, informację czy dane użytkowników są używane do trenowania modelu, DPA (Data Processing Agreement) zgodny z RODO, lokalizację serwerów (EU vs poza EOG). Profesjonalne platformy LegalTech powinny udostępnić te informacje bez problemów.

5 wniosków w zakresie AI Act dla partnera kancelarii

Od 2 sierpnia 2026 AI Act obejmuje każdą kancelarię używającą narzędzi AI zawodowo - niezależnie od wielkości.

- Czas działa przeciwko Tobie - pozostało mniej niż 5 miesięcy, a przygotowania do pełnej zgodności wymagają czasu i zaangażowania.

- Brak polskiej ustawy nie oznacza braku obowiązków - AI Act obowiązuje bezpośrednio jako rozporządzenie UE.

- Większość narzędzi dla prawników to niskie ryzyko - ale wymagają AI literacy i weryfikacji dostawcy.

- Wybór odpowiedniego dostawcy AI ma znaczenie prawne - kancelaria odpowiada za to, z jakich systemów korzysta i czy są zgodne z regulacją AI Act.

- Model review-first to nie tylko dobra praktyka, to wymóg - nadzór człowieka nad decyzjami AI jest elementem AI Act, nie opcją.

Kancelarie, które wybierają dostawcę AI z wbudowanym compliance, redukują koszty dostosowania do zera i eliminują ryzyko kar wynikające z niedopełnienia obowiązków.

Chcesz zobaczyć, jak LexAlpha działa w praktyce i jak wspiera zgodność Twojej kancelarii z AI Act? Umów bezpłatną prezentację →

Artykuł ma charakter informacyjny i nie stanowi porady prawnej. Stan prawny na 6 marca 2026 roku. W przypadku wątpliwości dotyczących klasyfikacji systemów AI używanych w Twojej kancelarii zalecamy konsultację z prawnikiem specjalizującym się w prawie nowych technologii.

Chcesz zobaczyć LexAlpha w akcji?

Umów bezpłatną prezentację i dowiedz się, jak AI może usprawnić pracę Twojej kancelarii - zgodnie z AI Act i RODO.

Umów prezentację → Przejdź do aplikacji

Przejdź do aplikacji